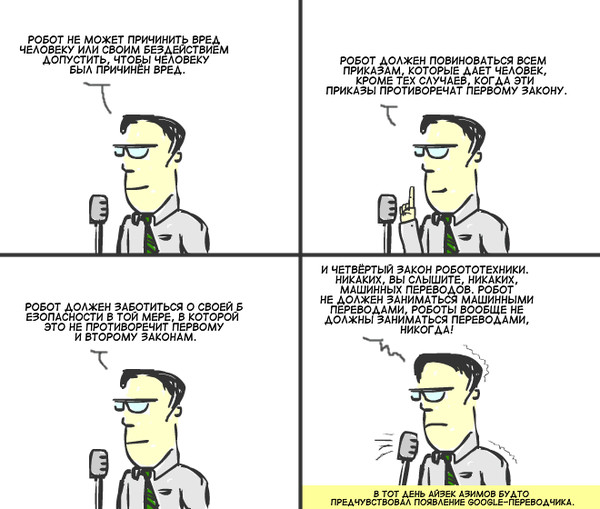

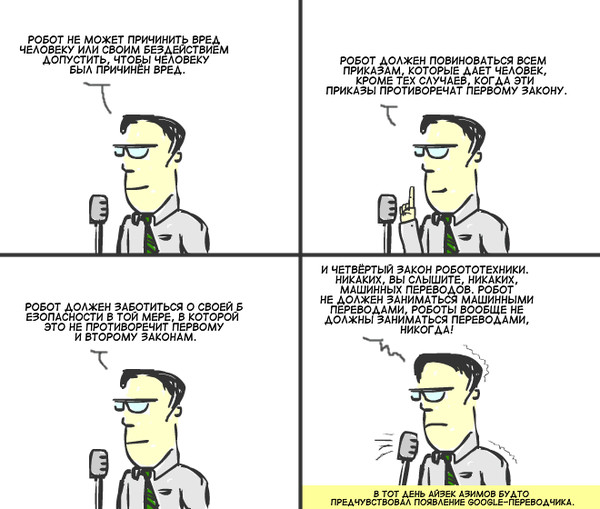

Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому и Второму Законам.

Прочее компьютерное

Сколько законов робототехники? Мы тут спорим :) Три или четыре? Ведь в 86 году дописан нулевой закон :)

иногда вспоминают еще один чисто ради лулзов :)

http://ru.wikipedia.org/wiki/Три_закона_робототехники

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому и Второму Законам.

Нулевой Закон

Айзек Азимов однажды добавил Нулевой Закон, сделав его более приоритетным, чем три основных. Этот закон утверждал, что робот должен действовать в интересах всего человечества, а не только отдельного человека. Вот как выражает его робот Дэниел Оливо в романе «Основание и Земля» :

0. Робот не может нанести вред человечеству или своим бездействием допустить, чтобы человечеству был нанесён вред.

Именно он был первым, кто дал этому закону номер — это произошло в романе «Роботы и империя» , правда, само понятие ещё раньше сформулировала Сьюзен Келвин — в новелле «Разрешимое противоречие» .

Французский переводчик Жак Брекар невольно сформулировал Нулевой Закон раньше, чем Азимов описал его явно. Ближе к завершению романа «Стальные пещеры» Элайдж Бейли замечает, что Первый Закон запрещает роботу наносить человеку вред, если только не будет уверенности, что это будет полезно для него в будущем. Во французском переводе («Les Cavernes d’acier (en)», 1956 год) мысли Бейли переданы несколько иначе [10]:

Робот не может причинить вреда человеку, если только он не докажет, что в конечном итоге это будет полезно для всего человечества.

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому и Второму Законам.

Нулевой Закон

Айзек Азимов однажды добавил Нулевой Закон, сделав его более приоритетным, чем три основных. Этот закон утверждал, что робот должен действовать в интересах всего человечества, а не только отдельного человека. Вот как выражает его робот Дэниел Оливо в романе «Основание и Земля» :

0. Робот не может нанести вред человечеству или своим бездействием допустить, чтобы человечеству был нанесён вред.

Именно он был первым, кто дал этому закону номер — это произошло в романе «Роботы и империя» , правда, само понятие ещё раньше сформулировала Сьюзен Келвин — в новелле «Разрешимое противоречие» .

Французский переводчик Жак Брекар невольно сформулировал Нулевой Закон раньше, чем Азимов описал его явно. Ближе к завершению романа «Стальные пещеры» Элайдж Бейли замечает, что Первый Закон запрещает роботу наносить человеку вред, если только не будет уверенности, что это будет полезно для него в будущем. Во французском переводе («Les Cavernes d’acier (en)», 1956 год) мысли Бейли переданы несколько иначе [10]:

Робот не может причинить вреда человеку, если только он не докажет, что в конечном итоге это будет полезно для всего человечества.

Похожие вопросы

- Закон о защита прав потребителей

- Тупой закон скоро будет, удалят все сайты с пиратскими программами, фильмами, фотографиями, играми!

- В Ubuntu вероятность заражения вирусом или трояном нулевая? Или не нулевая ?

- в экселе сумма ячеек равна 0, но в ячейках не нулевые значения.

- Почему журнал "ХАКЕР" публикует свои статьй открыто и их за это не преследуют законом.

- Люди!!!!Спасите!!! Спорим с зятем на шоколадку, а я чай как раз налила... Сколько в Кгбайте Мгбайт или наоборот?

- По отношению к кому я поступаю нечестно, когда покупаю "пиратские" диски, вместо лицензионных и какой закон я нарушаю?

- Имею ли я право, по закону, отдать свой лицензионный диск (софт / игра / фильм / что угодно) другому человеку?

- закон ОМА знаю, но вот путаюсь в таких мелких фикциях: 2лампы на 12вольт но одна на 21ват а другая на 60ват, соединены

- что за закон о запрете торрентов? это значит если я куплю диск и дам людям его слушать-то меня посадят?

0. Робот не может причинить вреда человеку, если только он не докажет, что в конечном счёте это будет полезно для всего человечества.